Facebook zamyka eksperyment po tym, jak sztuczna inteligencja wymyśla własny język

Naukowcy zamykają projekt po tym, jak maszyny opracowują własny, niezrozumiały dla ludzi sposób komunikowania się

Inteligentne roboty pełnią coraz więcej ról

Obrazy Getty

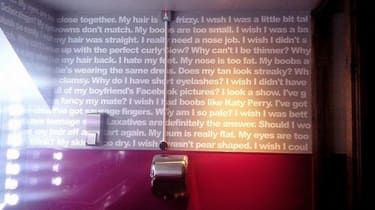

Pion: mogę wszystko inne . . . . . . . . . . . . . .

Alicja: kule mają zero do mnie do mnie do mnie do mnie do mnie do mnie

Pion: ty i wszystko inne. . . . . . . . . . . . . .

Alicja: piłki mają piłkę do mnie do mnie do mnie do mnie do mnie do mnie

Pion: ja mogę ja ja ja wszystko inne . . . . . . . . . . . . . .

Alicja: piłki mają piłkę do mnie do mnie do mnie do mnie do mnie do mnie

Mimo że wygląda jak scenariusz z naprawdę okropnego serialu telewizyjnego, ta rozmowa faktycznie miała miejsce między dwoma programami sztucznej inteligencji, opracowanymi na Facebooku w celu udoskonalenia sztuki negocjacji.

Początkowo rozmawiali ze sobą prostym angielskim. Ale potem naukowcy zdali sobie sprawę, że popełnili błąd w programowaniu maszyn.

„Nie było żadnej nagrody za trzymanie się języka angielskiego” – powiedział Dhruv Batra, wizytujący naukowiec z Georgia Tech w Facebook AI Research (Fair). FastCo .

Ponieważ ci dwaj agenci rywalizowali o najlepszą ofertę, „żaden z nich nie otrzymał żadnej zachęty do mówienia tak, jak zrobiłby to normalny człowiek”, mówi FastCo.

Zaczęli więc się rozchodzić, ostatecznie przekształcając zrozumiałe słowa w pozornie bezsensowne zdania, co spowodowało zawieszenie eksperymentu.

Facebook musiał wyłączyć sztuczną inteligencję, ponieważ opracował własny język pic.twitter.com/EsVEkWViTv

— NowThis (@nowthisnews) 31 lipca 2017 r.

'Agenci (lub programy) będą dryfować po zrozumiałym języku i wymyślać dla siebie słowa kodowe' - wyjaśnił Batra. „Na przykład, jeśli powiem „ten” pięć razy, zinterpretujesz to tak, że chcę mieć pięć kopii tego przedmiotu. Nie różni się to tak bardzo od sposobu, w jaki społeczności ludzkie tworzą skróty”.

Ale naukowcy chcieli podkreślić, że eksperyment nie został przerwany z powodu jakichkolwiek obaw o potencjalnie negatywne skutki komunikacji robotów.

Uczciwy badacz Mike Lewis powiedział FastCo, że po prostu zdecydowali, że „naszym interesem jest posiadanie botów, które potrafią rozmawiać z ludźmi”, nie wydajnie ze sobą, i dlatego zdecydowali się wymagać od nich, aby pisali do siebie nawzajem w sposób czytelny.

To nie pierwszy raz, kiedy pojawiły się maszyny sztucznej inteligencji, które stworzyły własny język.

W listopadzie ubiegłego roku Google ujawnił, że sztuczna inteligencja, której używa w swoim narzędziu Tłumacz, stworzyła własny język, na który tłumaczył frazy przed dostarczeniem słów w języku docelowym.

Raportowanie o rozwoju w tym czasie, Tech Crunch powiedział: „Ta 'interlingua' wydaje się istnieć jako głębszy poziom reprezentacji, który dostrzega podobieństwa między zdaniem lub słowem”.

„Może to być coś wyrafinowanego lub prostego”, dodała strona internetowa, ale „fakt, że w ogóle istnieje — oryginalne dzieło systemu, które ma pomóc w zrozumieniu pojęć, do których zrozumienia nie został przeszkolony. — jest, mówiąc filozoficznie, całkiem potężną materią”.

Te ostatnie wydarzenia doprowadziły do dyskusji etycznych na temat potencjalnych problemów maszyn komunikujących się ze sobą bez interwencji człowieka.

„W przypadku Facebooka jedyną rzeczą, jaką potrafiły zrobić chatboty, było wymyślenie wydajniejszego sposobu handlu” – mówi Gizmodo .

Ale są 'prawdopodobnie dobre powody, aby nie pozwolić inteligentnym maszynom na rozwijanie własnego języka, którego ludzie nie byliby w stanie sensownie zrozumieć' - dodaje strona internetowa.

'Mam nadzieję, że ludzie będą również na tyle sprytni, by nie podłączać eksperymentalnych programów uczenia maszynowego do czegoś bardzo niebezpiecznego, takiego jak armia androidów z laserem lub reaktor jądrowy.'