Czy powinniśmy się martwić o sztuczną inteligencję?

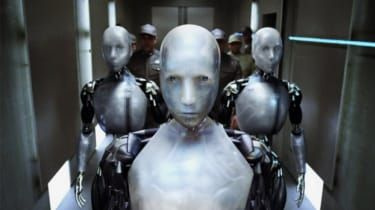

In Depth: pojawienie się robotów AI może stworzyć lub złamać przyszłość ludzkości

Inteligentne roboty pełnią coraz więcej ról

Obrazy Getty

Sukces w tworzeniu efektywnej AI może być największym wydarzeniem w historii naszej cywilizacji. Albo najgorsze. Po prostu nie wiemy, powiedział profesor Stephen Hawking podczas szczytu internetowego w Lizbonie w tym tygodniu.

Oprócz wielu korzyści, powiedział Hawking, sztuczna inteligencja (AI) niesie ze sobą wiele niebezpieczeństw, takich jak potężna broń autonomiczna lub nowe sposoby uciskania wielu przez nielicznych.

Fizyk wezwał do wprowadzenia nowych przepisów, aby ludzkość mogła zapobiec zagrożeniu przez sztuczną inteligencję jej egzystencji.

Być może wszyscy powinniśmy zatrzymać się na chwilę i skupić nie tylko na tym, by nasza sztuczna inteligencja była lepsza i skuteczniejsza, ale także na korzyści dla ludzkości – dodał.

Hawking nie jest jedynym luminarzem ze świata nauki i technologii, który ostrzegał przed przyszłością sztucznej inteligencji.

Wszyscy powinniśmy bardzo uważać na sztuczną inteligencję, Bill Gates powiedział wcześniej w tym roku. Jeśli miałbym zgadywać, jakie jest nasze największe zagrożenie egzystencjalne, to prawdopodobnie to. Dzięki sztucznej inteligencji przyzywamy demona.

W ostatnich miesiącach pojawiły się nagłówki o zabójczych robotach i automatyzacji zastępującej ludzi, ale także o algorytmach pomagających diagnozować raka i pomyślnym rozwoju autonomicznych samochodów.

Niektórzy uczeni twierdzą, że jest to najbardziej palące ryzyko egzystencjalne, jakie może kiedykolwiek napotkać ludzkość, podczas gdy inni w większości odrzucają hipotetyczne niebezpieczeństwo jako bezpodstawne sianie zagłady, mówi Płyta główna Phil Torres.

Czy powinniśmy się więc martwić rozprzestrzenianiem się sztucznej inteligencji? A co możemy z tym zrobić?

Reakcja na AI

DO YouGov Badanie przeprowadzone w zeszłym roku na ponad 2000 osób wykazało, że nastawienie opinii publicznej do sztucznej inteligencji jest bardzo różne w zależności od jej zastosowania.

Około 70% respondentów było zadowolonych z inteligentnych maszyn do wykonywania pozornie służebnych prac, takich jak monitorowanie upraw – ale spadło to do 49% w przypadku prac domowych, podczas gdy tylko 23% byłoby zadowolonych, gdyby roboty wykonywały operacje medyczne. A zaledwie 17% było zadowolonych z pomysłu tak zwanych robotów seksualnych.

Jednym z głównych obaw związanych z AI jest jej bezosobowy charakter.

W sierpniu prezes Tesli i SpaceX, Elon Musk, wraz ze 115 innymi specjalistami od sztucznej inteligencji i robotyki, podpisał list otwarty wzywa ONZ do rozpoznania niebezpieczeństw związanych ze śmiercionośną bronią autonomiczną i do zakazu jej użycia na arenie międzynarodowej.

Według Human Rights Watch Stany Zjednoczone, Chiny, Izrael, Korea Południowa, Rosja i Wielka Brytania inwestują w rozwój systemów uzbrojenia o malejącym poziomie kontroli człowieka w krytycznych funkcjach wyboru i atakowania celów.

Steven Finlay , autor Sztucznej inteligencji i uczenia maszynowego dla biznesu, uważa, że autonomiczne uzbrojone roboty, które mogą śledzić i namierzać ludzi za pomocą oprogramowania do rozpoznawania twarzy, są tuż za rogiem.

Sztuczna inteligencja i robotyka rozwijają się tak szybko, że w ciągu kilku lat wojny mogą być toczone przy użyciu autonomicznej broni i pojazdów, doniesienia Opiekun .

Regulować czy eksterminować?

Jedną z odpowiedzi na ten problem jest regulacja AI.

Zdrowa, nowoczesna demokracja wymaga od zwykłych obywateli udziału w publicznych dyskusjach na temat szybko rozwijających się technologii. Rozpaczliwie potrzebujemy nowych zasad, przepisów i siatek bezpieczeństwa dla osób przesiedlonych przez maszyny, mówi Naród Katharine Dempsey.

Elon Musk zgadza się. W 2014 roku powiedział: Coraz bardziej skłonny jestem sądzić, że powinien istnieć pewien nadzór regulacyjny, być może na poziomie krajowym i międzynarodowym, aby upewnić się, że nie zrobimy czegoś bardzo głupiego.

Prawdopodobnie największym zmartwieniem jest to, że maszyny mogą stać się lepsze w podejmowaniu decyzji niż ludzie, zniewalając ludzkość przez zautomatyzowanych decydentów i tego, kto je kontroluje.

Systemy oparte na sztucznej inteligencji już zastępują wiele miejsc pracy. Na przykład niektóre maszyny AI mogą wykryć raka skóry tak dokładnie, jak ludzki lekarz, Przewodowy raporty.

Na wiele naszych wyborów ma już wpływ sztuczna inteligencja za pośrednictwem stron internetowych, takich jak Amazon i Facebook. Algorytmy określają treści, które oglądamy w Internecie, i wydają rekomendacje dotyczące wszystkiego, od tego, co oglądamy w telewizji i gdzie jemy, po to, z kim się spotykamy.

To, co czyni ten scenariusz tak niebezpiecznym, to fakt, że nie jest on planowany przez jakąś nadrzędną inteligencję lub władcę maszyn, mówi Steven Finlay. Tworzymy technologię, która może doprowadzić do naszego upadku.

Zmiana na lepsze?

To nie tylko zguba i mrok.

Jestem optymistą, że możemy stworzyć inspirującą przyszłość dzięki sztucznej inteligencji, jeśli wygramy wyścig między rosnącą potęgą sztucznej inteligencji a rosnącą mądrością, z jaką nią zarządzamy, ale to będzie wymagało planowania i pracy, fizyk Max Tegmark, autor Life 3.0: Bycie człowiekiem w erze sztucznej inteligencji, opowiadane Płyta główna .

Podczas gdy Tegmark opowiada się za regulacją, argumentuje, że należy również skupić się na zaletach korzystania ze sztucznej inteligencji. Konkluduje, że jeśli ludzie skupiają się tylko na wadach, paraliżuje ich strach, a społeczeństwo ulega polaryzacji i podziałom.